(in italiano sotto)

From 16 to 19 November, the PhotoVogue Festival 2023 was held in Milan, whose theme was 'What Makes Us Human? Image in the Age of A.I.".

I had the pleasure of being one of the speakers, with a lecture entitled 'Broken Mirror. A dystopian guide to crossing the border', and to exhibit my project Broken Mirror, together with authors such as Charlie Engman, Jonas Bendiksen, Michael Christopher Brown and others. The group exhibition was curated by Chiara Bardelli Nonino.

More info here: PhotoVogue Festival 2023.

Below you will find the transcript of my lecture in English and Italian.

A WITNESS TO REALITY

My name is Filippo Venturi and I am a documentary photographer. My job requires being a reliable witness of reality. Through my photographic projects, I tell true stories and strive to do so honestly for those who will observe my photographs. I also have a degree in Computer Science, so over the years I have carefully observed technological innovations, especially those related to imagery. In recent months, TTI (text to image) software has made remarkable progress. Today it can generate images that effectively mimic photographs. This has prompted me to reflect on the future of coexistence between photographs and images generated with artificial intelligence.

COEXISTENCE OF PHOTOGRAPHS AND SYNTHOGRAPHS

In some areas, such as advertising photography, the advertised product was already idealised and thus distanced from reality, with physical or digital interventions. Therefore, I believe that photographs and synthographs will be indistinguishable and alternating in this field, at least for those who consume them, aware of the distance from reality. There are already advertising campaigns created without the use of photographers. Maybe only a widely echoed campaign is needed to make this phenomenon evident to everyone.

COEXISTENCE OF PHOTOJOURNALISM AND SYNTHOGRAPHY

Concerning documentary photography and photojournalism, I hope they continue to travel on a parallel track to generated images. However, I acknowledge that this might not be the case in future.

A few months ago, Amnesty International used synthographs in place of photographs to protect Colombian protesters attending a 2019 protest, to promote a cause that, for this reason, finished in the background. Those synthographs attracted a lot of controversy, despite Amnesty International explicitly stated that they had used them. Surely they chose the wrong time to do this experiment.

COULD IT BE A FAIR IDENTIKIT OF REALITY?

However, I wonder whether, in the future, the generated images could be used to make what I call 'identikit of reality'. Already today, in the absence of a photograph, a sketch of a crime suspect is made based on eyewitness descriptions. When an event happens in the future without photographers ready to document it, will we reconstruct that event in that location, with images generated with the help of possible eyewitnesses? Already with photography we cannot show the complexity of reality. What to photograph, how to frame it, which photographs to discard, etc. represent so many layers where we forfeit a slice of reality. But representing it without any contact risks distancing us even further.

BROKEN MIRROR

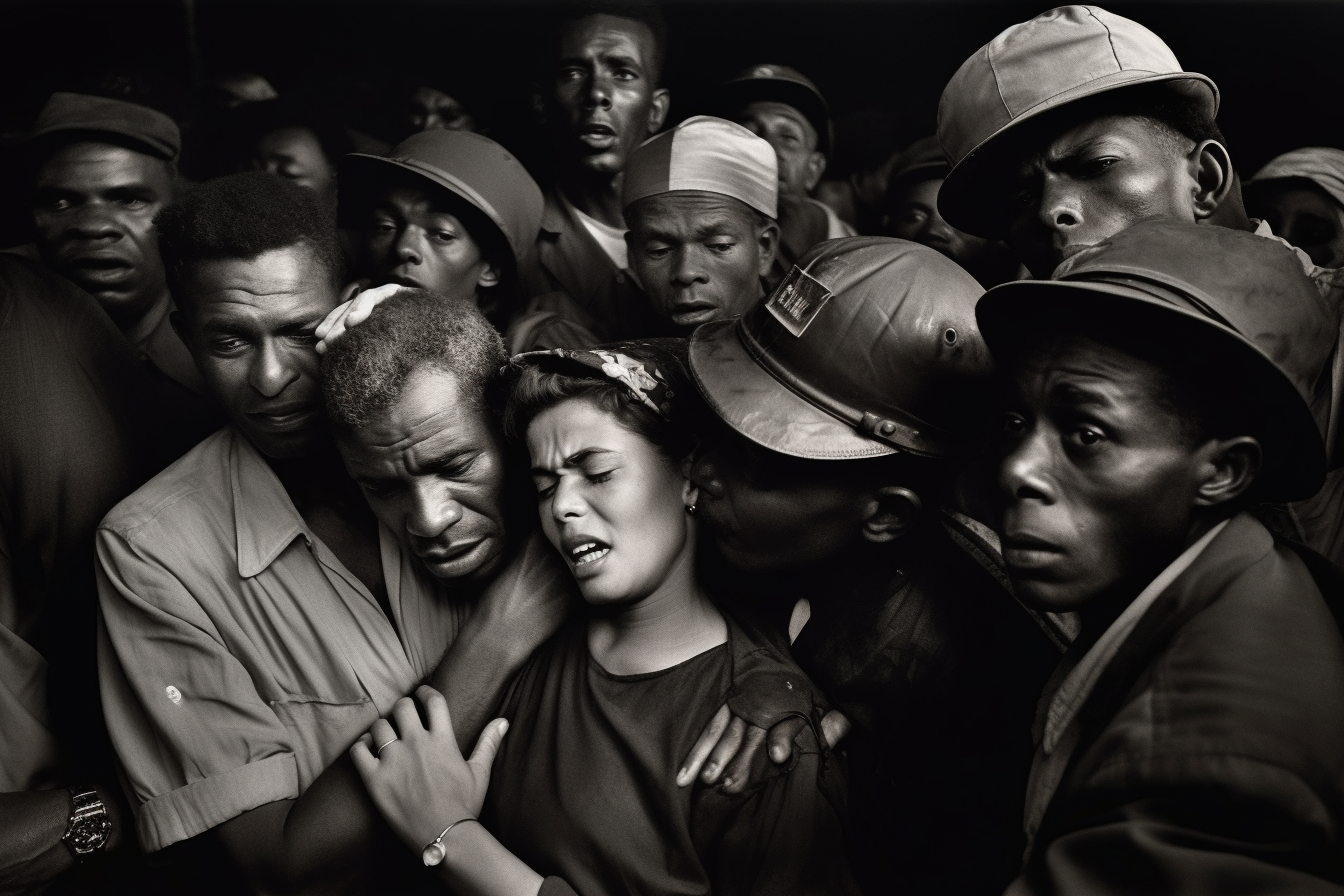

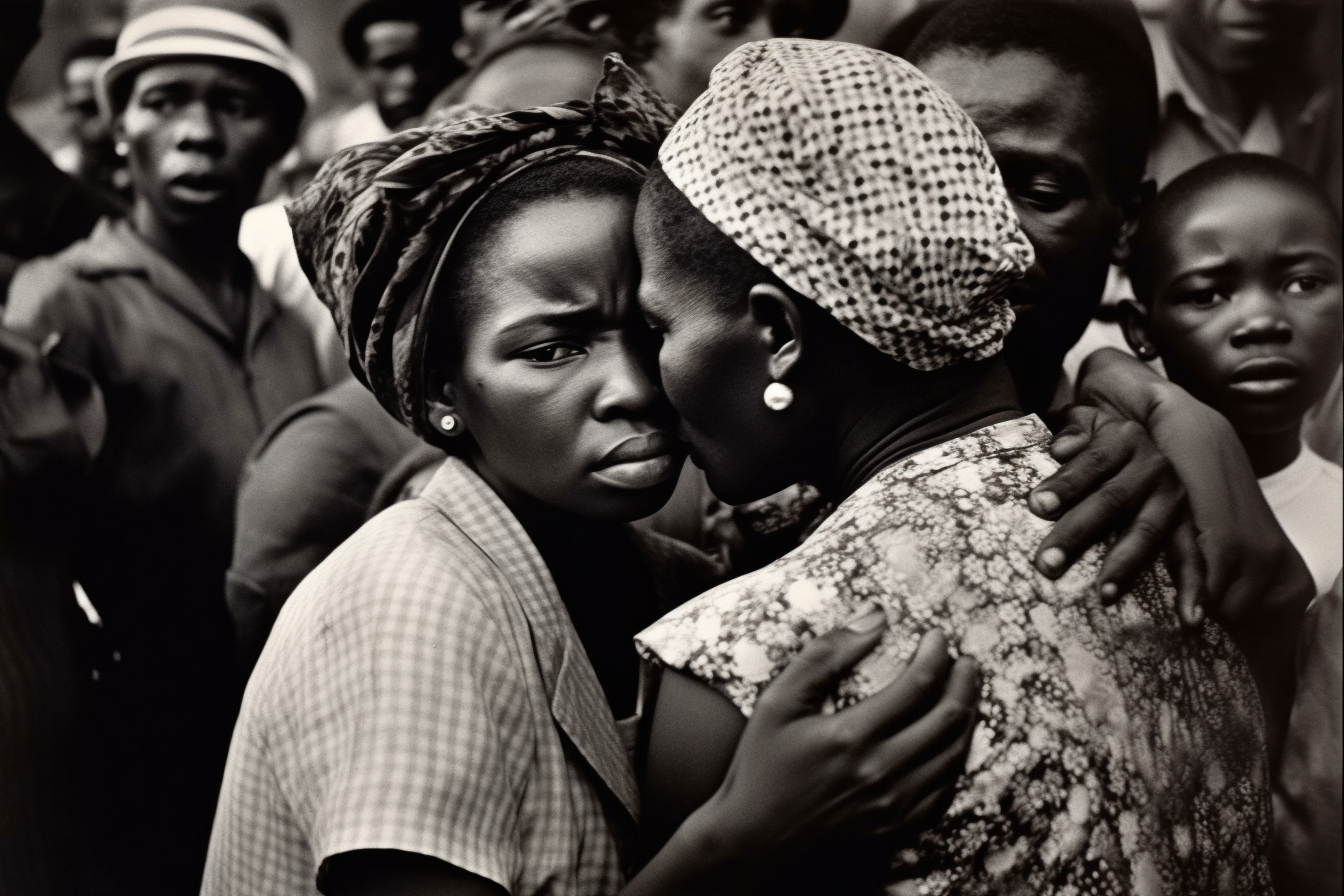

In recent months, I started working with artificial intelligence and generating images. With these softwares I could have created any kind of image. I could have improvised as a comic book artist for example. But in the end I came back to themes I like and know better. I didn't want to use artificial intelligence simply as a shortcut, but I wanted it to be conceptually relevant within the visual project I was developing. In one of these works, I tried to portray in a different way the totalitarian dictatorship that characterises North Korea, a country I had already visited and reported on as a documentary photographic report. This work is called Broken Mirror and uses a language that mimics a documentary style in photography. The basic idea is to insert an alien and destabilising element into the daily life of North Koreans. I chose to introduce insects and spiders, which gradually increase in quantity and size, until they take complete control over the North Koreans. At some point though, the North Koreans themselves begin to transform into these giant insects and they finally become the creatures they used to fear: this actually symbolises their complete submission.

THE INVASIVE AND CONTROLLING NATURE OF TECHNOLOGY

Generating the images the way I had conceived and described them with the prompt, required thousands of attempts and a lot of frustration. The creative process was largely in the hands of artificial intelligence.

However, the selection of images was a compromise between what I wanted to achieve and what I was offered. I did not always get what I wanted. Other times the artificial intelligence inserted unexpected elements that I chose to keep. During this process, I realised that the metaphor I had used, did not just represent the North Korean totalitarian dictatorship, but it did also represent technology itself. In particular, its invasive and controlling nature. With my work, I therefore exploited the new potential that artificial intelligence offers, to express a fear I have towards it.

BREATHING REALITY

After several months fully immersed in this technology, I felt a strong need to return to photographing people's stories. This new technology will be part of the tools l use in the future, but the quiet, solitary nights spent at the computer generating images, reminded me why, at one point in my life, I set aside my passion for computing to embrace photography. I needed to step outside, breathe in reality and eventually capture its traces with my camera.

“Broken Mirror. A dystopian guide to crossing the border“ lecture at Photo Vogue Festival, Milan, Italy, November 18, 2023.

Dal 16 al 19 novembre si è tenuto il PhotoVogue Festival 2023 a Milano, il cui tema è “What Makes Us Human? Image in the Age of A.I.“.

Ho avuto il piacere di essere uno degli speaker, con una conferenza intitolata “Broken Mirror. A dystopian guide to crossing the border”, e di esporre il mio progetto Broken Mirror, assieme ad autori come Charlie Engman, Jonas Bendiksen, Michael Christopher Brown e altri ancora. La mostra collettiva era a cura di Chiara Bardelli Nonino.

Maggiori informazioni qui: PhotoVogue Festival 2023.

Di seguito troverete la trascrizione della mia conferenza in inglese e in italiano:

UN TESTIMONE DELLA REALTÀ

Mi chiamo Filippo Venturi e sono un fotografo documentarista. Il mio lavoro consiste nell’essere un testimone attendibile della realtà. Con i miei lavori fotografici racconto storie vere e cerco di farlo con onestà verso chi osserverà le mie fotografie. Ho anche una laurea in Scienze dell’Informazione e quindi negli anni ho osservato con attenzione le novità tecnologiche, soprattutto quelle legate all’immagine.

Negli ultimi mesi i software TTI (text to image) hanno fatto progressi notevoli. Oggi possono generare immagini che imitano con efficacia le fotografie. Questo mi ha spinto a riflettere sul futuro della convivenza fra fotografie e immagini generate con l’intelligenza artificiale.

CONVIVENZA FRA FOTOGRAFIE E SINTOGRAFIE

In alcuni settori, come la fotografia pubblicitaria, il prodotto pubblicizzato veniva già idealizzato e quindi allontanato dalla realtà, con interventi fisici o digitali. Credo quindi che fotografie e sintografie (cioè le immagini generate) saranno indistinguibili e alternabili in questo campo, almeno per chi ne fruirà, consapevole della distanza dalla realtà. Ci sono già campagna pubblicitarie realizzate senza l’uso di fotografi. Forse manca soltanto una campagna pubblicitaria che abbia una grande eco e che raggiunga le masse, per rendere evidente a tutti questo fenomeno.

CONVIVENZA FRA FOTOGIORNALISMO E SINTOGRAFIE

Per quanto riguarda la fotografia documentaria e il fotogiornalismo, mi auguro che continuino a viaggiare su un binario parallelo da quello delle immagini generate. Ma so che probabilmente non sarà così.

Pochi mesi fa Amnesty International ha utilizzato delle sintografie in sostituzione delle fotografie, per tutelare i manifestanti colombiani presenti a una protesta del 2019, per promuovere una causa che per questo motivo è finita in secondo piano. Quelle sintografie hanno attirato molte polemiche, nonostante Amnesty International avesse dichiarato esplicitamente di averne fatto uso. Sicuramente hanno scelto il momento sbagliato per fare questo esperimento.

IDENTIKIT DELLA REALTÀ

Mi domando però se, in futuro, le immagini generate potranno essere usate per realizzare quelli che io chiamo “identikit della realtà”. Già oggi, in mancanza di una fotografia, viene realizzato un identikit di un sospettato di un crimine basandosi sulle descrizioni di testimoni oculari. Quando in futuro accadrà un evento senza fotografi pronti a documentarlo, ricostruiremo quell’evento in quel luogo, con immagini generate con l’aiuto di eventuali testimoni oculari? Già con la fotografia rinunciamo alla complessità della realtà. Cosa fotografare, come inquadrarlo, quali fotografie scartare, ecc. rappresentano tanti strati in cui rinunciamo ad una fetta di realtà. Ma rappresentarla senza alcun contatto con essa, rischia di allontanarci ancora di più da essa.

BROKEN MIRROR

Nei mesi scorsi ho iniziato a lavorare con l’intelligenza artificiale e a generare immagini. Con questi software avrei potuto realizzare qualsiasi tipo di immagine. Avrei potuto improvvisarmi fumettista, ad esempio. Ma alla fine sono tornato ai temi a me più cari e che conosco meglio. Non volevo usare l’intelligenza artificiale soltanto come una scorciatoia, ma volevo che fosse concettualmente rilevante all’interno del progetto visivo che stavo sviluppando. In uno di questi lavori ho provato a raccontare in un modo diverso la dittatura totalitaria che caratterizza la Corea del Nord, un paese che avevo già visitato e raccontato come fotografo documentarista. Questo lavoro si intitola Broken Mirror e utilizza un linguaggio che imita quello documentarista. L’idea alla base consiste nell’inserire nella vita quotidiana dei nordcoreani un elemento alieno e destabilizzante. Ho scelto di inserire degli insetti, dei ragni e altro ancora, che gradualmente aumentato di quantità e dimensione, fino a prendere il controllo completo sui nordcoreani. Ad un certo punto i nordcoreani stessi iniziano a trasformarsi in questi insetti giganti, diventando le creature che temevano, simboleggiando il completamento della sottomissione.

LA NATURA INVASIVA E CONTROLLANTE DELLA TECNOLOGIA

Generare le immagini così come le avevo pensate e descritte col prompt ha richiesto migliaia di tentativi e molta frustrazione. Il processo creativo era in gran parte affidato all’intelligenza artificiale. La selezione delle immagini era però un compromesso fra ciò che volevo ottenere e ciò che mi veniva proposto. Spesso non ho ottenuto quello che volevo. Altre volte l’intelligenza artificiale ha inserito elementi inaspettati che però ho scelto di tenere. Durante questo processo, ho realizzato che la metafora che avevo utilizzato non rappresentava soltanto la dittatura totalitaria nordcoreana, ma rappresentava la tecnologia stessa. In particolare la sua natura invasiva e controllante. Col mio lavoro ho quindi sfruttato le nuove potenzialità che l’intelligenza artificiale offre, per esprimere un timore che ho nei suoi confronti.

EMERSIONE

Dopo alcuni mesi di full immersion in questa tecnologia, ho sentito un forte bisogno di tornare a fotografare le storie delle persone, come se ne fossi stato in astinenza. Questa nuova tecnologia farà parte degli strumenti che adopererò anche in futuro, ma le ore notturne, silenziose e solitarie passate al computer a generare immagini mi hanno ricordato perché, a un certo punto della mia vita, avevo accantonato la mia passione per l’informatica per abbracciare quella per la fotografia. Avevo bisogno di uscire e di respirare la realtà e, infine, di raccoglierne le tracce con la mia macchina fotografica.